Claude Cowork débarque, le RSSI n'a pas été prévenu

Quand l'IA autonome s'installe sur les postes sans passer par la case cybersécurité : retour terrain sur notre plan d'urgence

Contexte

Il y a quelques semaines, un collaborateur vient me voir avec un enthousiasme non dissimulé. Il me montre son écran : Claude Cowork est en train de naviguer sur son ordinateur, d’ouvrir des fichiers, de modifier des documents, de lancer des recherches web. Le tout de manière autonome. Ma première réaction en tant que RSSI : un mélange de fascination technique et de sueur froide.

Claude Cowork, pour ceux qui ne connaissent pas encore, c’est la dernière évolution d’Anthropic. Ce n’est plus un simple chatbot à qui on pose des questions. C’est un agent IA qui prend le contrôle de votre poste de travail : il navigue dans Chrome, écrit des fichiers, exécute du code, interagit avec vos outils métier, se connecte à vos MCP servers, accède à vos données locales. En clair, c’est un collaborateur virtuel avec les droits de la session de l’utilisateur.

Et le problème, c’est que ce n’est pas un cas isolé. En deux semaines, nous avons identifié plus d’une dizaine de collaborateurs qui avaient déjà installé et utilisé l’outil, certains sur des environnements connectés à des services critiques. Personne n’avait demandé d’avis à la DSI, encore moins au RSSI.

Pourquoi c’est différent de ChatGPT

On avait déjà géré l’arrivée de ChatGPT. On avait mis en place des mesures, sensibilisé, encadré l’usage. Mais avec Claude Cowork, on change complètement de dimension. Ce n’est plus l’utilisateur qui copie-colle des données dans un chatbot. C’est l’IA elle-même qui accède directement à l’environnement de travail.

Les risques que nous avons identifiés rapidement :

Prise de contrôle de la session utilisateur

Claude Cowork opère avec les mêmes droits que l’utilisateur connecté. Si le collaborateur a accès à un ERP, à un CRM, à des partages réseau sensibles, l’IA y a accès aussi. Il n’y a pas de ségrégation de droits entre ce que fait l’humain et ce que fait l’agent.

Prompt injection et manipulation externe

C’est le risque le plus sous-estimé. Quand Claude Cowork navigue sur le web ou ouvre des documents, il peut lire du contenu malveillant injecté dans des pages web, des emails ou des fichiers partagés. Un attaquant peut cacher des instructions dans un document anodin qui redirigent le comportement de l’IA. On parle ici d’indirect prompt injection : l’IA exécute une action qu’on ne lui a jamais demandée parce qu’elle a lu une instruction cachée.

Modification et destruction de données

L’IA peut créer, modifier et supprimer des fichiers. Elle peut écrire du code et l’exécuter directement sur le poste. Une mauvaise instruction, une hallucination, ou un prompt injection bien placé, et on se retrouve avec des fichiers critiques altérés ou supprimés.

Fuite de données vers l’extérieur

Chaque interaction avec Claude Cowork envoie des données aux serveurs d’Anthropic. Les fichiers lus, les pages visitées, le contexte de travail : tout remonte. Dans un environnement où l’on manipule des données clients, des documents stratégiques ou des informations financières, cette question de souveraineté des données ne peut pas être ignorée.

Les 7 étapes que nous avons initiées en urgence

Face à la vitesse de déploiement spontané de l’outil, nous avons décidé de ne pas interdire mais d’encadrer. Interdire un outil que les collaborateurs trouvent productif, on sait comment ça finit : ça passe en Shadow IT et on perd toute visibilité.

1. Sensibilisation aux risques spécifiques de l’IA agentique

Première action, et probablement la plus urgente : sensibiliser. Pas une sensibilisation générique sur l’IA, mais ciblée sur les risques propres à un agent autonome. Nous avons organisé des sessions courtes avec les équipes concernées pour expliquer la différence entre un chatbot classique et un agent qui agit sur votre poste. La démonstration en live d’un prompt injection sur Claude Cowork a eu un effet immédiat sur la prise de conscience.

2. Mise à jour de la charte informatique

Notre charte informatique ne couvrait pas les agents IA autonomes. Nous avons ajouté une section dédiée couvrant l’utilisation des agents IA : périmètre autorisé, types de données interdites, obligation de déclaration préalable. Cette mise à jour a été validée en urgence avec le DPO et le service juridique.

3. Onboarding systématique par l’IT

Règle non négociable : tout déploiement de Claude Cowork ou d’un agent IA similaire doit passer par l’IT. Pas d’installation sauvage. L’équipe IT vérifie l’environnement, les droits de l’utilisateur, les connexions aux services et les MCP configurés. C’est aussi l’occasion d’appliquer le principe du moindre privilège.

4. Restriction aux environnements sans impact production

C’est la mesure la plus structurante. Nous avons décidé que Claude Cowork ne pouvait être utilisé que sur des comptes et des environnements n’ayant aucun impact sur les services de production, les systèmes industriels et les données clients critiques. En clair : oui pour de la rédaction, de la recherche, du prototypage sur des environnements isolés. Non pour tout ce qui touche à l’opérationnel.

5. Accompagnement Safe AI avec limites de contrôle

Plutôt que de laisser les utilisateurs seuls face à l’outil, nous avons mis en place un accompagnement. Chaque nouveau cas d’usage passe par une évaluation rapide avec l’équipe cybersécurité : quelles données sont concernées, quels accès sont nécessaires, quelles sont les limites de contrôle à configurer.

6. Revue régulière a posteriori

Comme la technologie est nouvelle et que les cas d’usage évoluent vite, nous avons instauré une revue régulière des usages. Toutes les deux semaines, nous analysons les logs d’utilisation, les incidents éventuels, les retours des utilisateurs. C’est du pilotage adaptatif, pas du contrôle rigide.

7. Recherche de solutions sur le marché

Dernier point : nous avons lancé une veille active sur les solutions de sécurisation de l’IA agentique. Plusieurs startups sont en train de se positionner sur ce créneau avec des offres de monitoring, de sandboxing et de contrôle des agents IA. Le marché est encore très jeune, mais il est essentiel de suivre l’évolution. Nous évaluons actuellement trois acteurs spécialisés.

Ce qu’il faut retenir

L’IA agentique représente un changement de paradigme en cybersécurité. On ne parle plus de fuites de données via un copier-coller dans un chatbot. On parle d’un agent autonome qui agit sur nos systèmes avec les droits de nos collaborateurs. Le sujet est trop sérieux pour le traiter en réaction. Il faut anticiper, encadrer, accompagner.

D’expérience, la clé est de ne pas se positionner en opposant mais en accompagnateur. Les collaborateurs vont utiliser ces outils, avec ou sans nous. Notre rôle en tant que RSSI est de créer le cadre qui permet l’innovation sans mettre en danger l’entreprise.

Ressources CyberLead

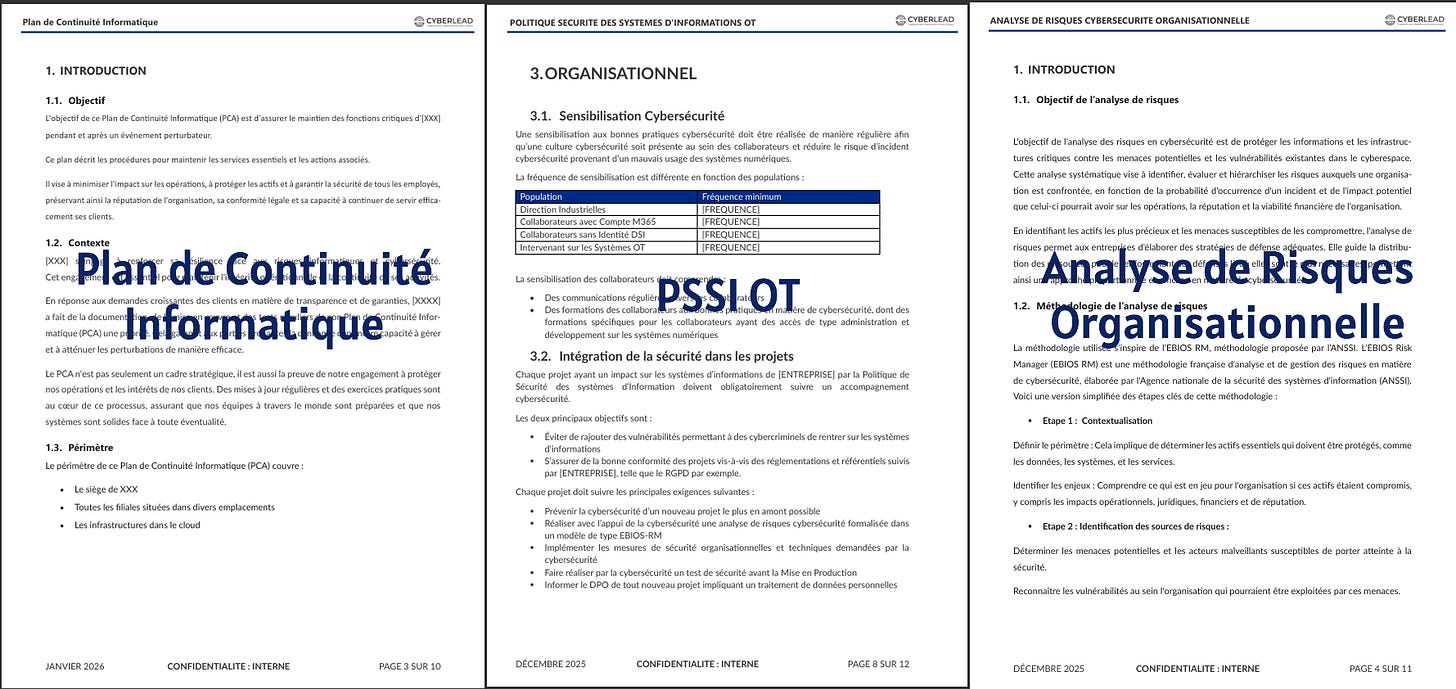

Afin de faire connaitre CyberLead, dont je suis le CEO , j’ai conçu le Kit RSSI avec un ensemble de templates et documents issus de mon expérience de RSSI dans des structures de différentes tailles et différentes maturités. Chaque livrable est pensé pour être utilisé en situation réelle : gouvernance, conformité, projets et opérations.

Vous voyez un post LinkedIn sur le sujet , n’hésitez pas et partagez cet article en commentaire !