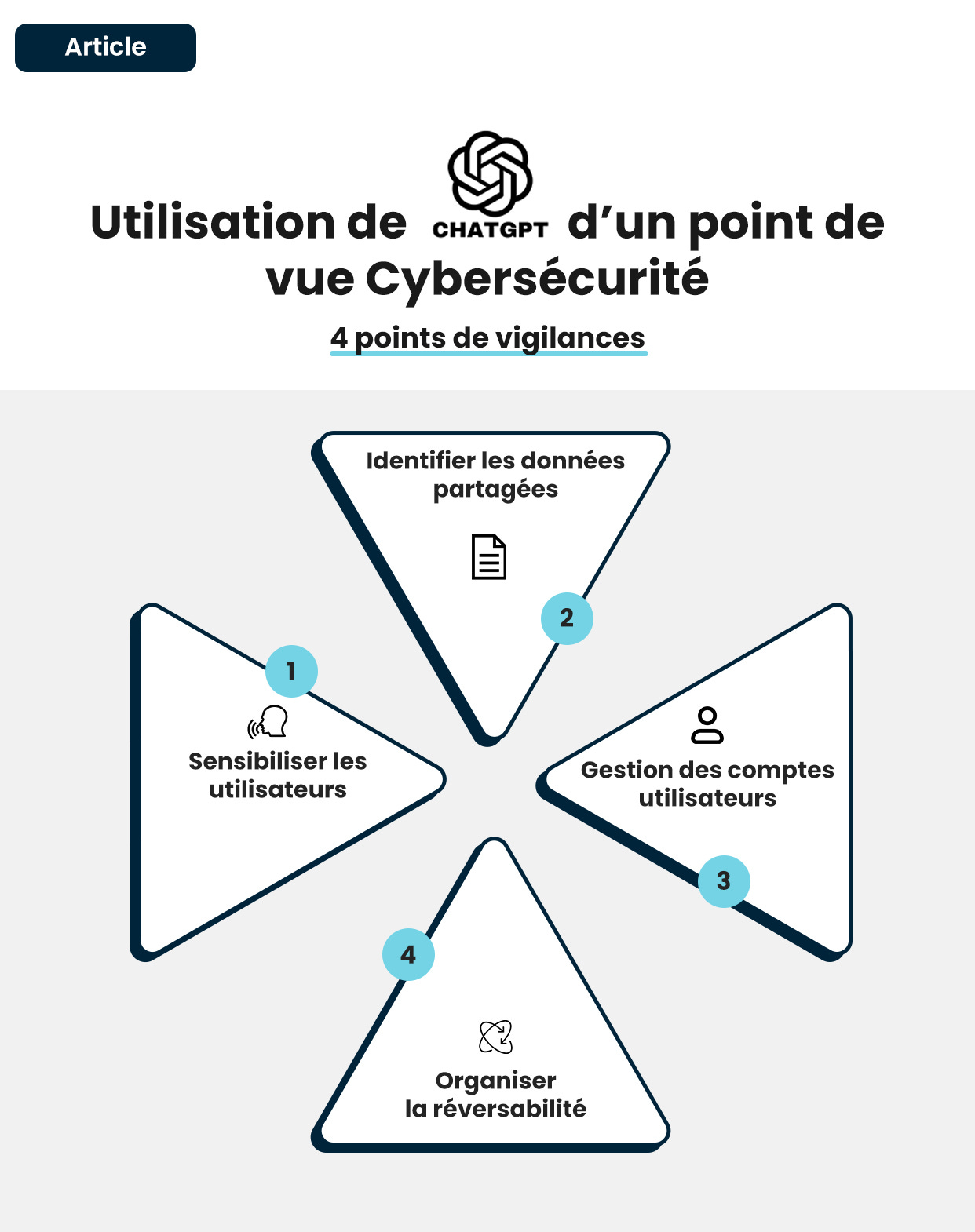

Comment gérer concrètement l'usage de ChatGPT d'un point de vue cybersécurité pour ses collaborateurs

ChatGPT fête ses 1 an, et désormais l’outil fait partie de notre quotidien. Je suis désormais régulièrement challengé sur la façon de gérer ChatGPT d’un point de vue cybersécurité pour les DSI.

Dans cet article, je vous propose mon analyse cybersécurité concernant l’usage de ChatGPT et les mesures concrètes à mettre en œuvre selon moi.

Un nouvel usage à encadrer

Je crois fermement que la cybersécurité devrait être au service des organisations, plutôt que de constituer un obstacle à l'innovation. Ayant travaillé dans la Silicon Valley, je suis passionné par les nouvelles technologies numériques. Je fais partie de ceux qui estiment qu'il est crucial de s'approprier rapidement l'utilisation de l'intelligence artificielle générative et d'explorer ses bénéfices potentiels.

Concernant ChatGPT, il n'est plus question de se demander si c'est un outil utilisé par les collaborateurs ; c'est une certitude. Avec près de 200 millions d'utilisateurs dans le monde un an seulement après son lancement, son usage est incontestable.

Du point de vue de la cybersécurité, cela signifie que, comme pour tout nouvel outil, il est essentiel de gérer les risques associés spécifiques à chaque organisation. Dans une des entreprises que nous avons conseillées, qui utilise désormais ChatGPT de manière intensive, la question de la disponibilité de ChatGPT est devenue un enjeu critique.

MESURE CYBER-GPT-01 : Réaliser une analyse de risque cybersécurité sur l’usage de ChatGPT comme un nouvel outil pour l’entreprise

Besoin d’aide pour mettre en œuvre cette mesure ? N’hésitez pas à venir échanger avec nous à ce sujet. Envoyez moi un message Substack ou Linkedin

Sensibiliser sur les données partagées à ChatGPT

Le principal problème avec ChatGPT est la possibilité d'y envoyer des informations critiques. J'ai vu des entreprises copier-coller le contenu de leur Road Map produit dans l’outil. En utilisant des prompts, elles peuvent par exemple rendre ces Road Map plus professionnelles ou utiliser ChatGPT comme critique de leur vision. On peut ainsi imaginer de nombreux types de données sensibles partagées.

Là où ça pique vraiment, c’est la possibilité désormais d’envoyer ds fichiers sur ChatGPT pour analyse. Et là, j’ai vécu des trucs horribles. J’ai vu par exemple une liste des personnes en situation de handicap balancé à chatgpt, en demandant des synthèses sur le type d’accessibilité demandé et les prises en charge nécessaires. J’ai vu des bilans d’entreprises balancés à chatgpt pour analyse. L’enfer d’un point de vue cybersécurité.

Encore pire, la nouvelle fonctionnalité de ChatGPT permet d'analyser des fichiers. J'ai été témoin de situations alarmantes. En voici deux qui m’ont particulièrement marqué :

Une liste de personnes en situation de handicap a été partagée à ChatGPT pour obtenir des résumés sur les types d'accessibilité nécessaires et les prises en charge requises

Des bilans financiers d'entreprises partagés dans le but d’obtenir une analyse par ChatGPT.

Ces pratiques représentent un véritable cauchemar en termes de cybersécurité.

Il est ainsi important de sensibiliser les utilisateurs de ChatGPT sur les risques que peuvent entraîner le partage de ce type de document. Sans mentionner ce qui touche à la propriété intellectuelle. Une solution pourrait être d’organiser des réunions d’équipe afin qu’une personne du pôle cybersécurité puisse sensibiliser sur les risques.

MESURE CYBER-GPT-02 : organiser avec chaque équipe utilisant ChatGPT une sensibilisation animé par un expert cybersécurité

Besoin d’aide pour mettre en œuvre cette mesure ? N’hésitez pas à venir échanger avec nous à ce sujet.

Utiliser des adresses mails professionnelles pour ChatGPT

Lors du lancement de ChatGPT, la majorité des utilisateurs s'est inscrite avec leurs comptes personnels, ce qui semblait logique étant donné l'usage prévu à l'époque. Cependant, avec le temps, de nombreux utilisateurs ont commencé à se servir de ChatGPT à des fins professionnelles. Beaucoup de discussions ont été initiées dans des contextes directement liés à l'entreprise. Certains sont même allés plus loin en utilisant les API pour automatiser et intensifier l'utilisation de ChatGPT dans un cadre professionnel.

L'utilisation de comptes personnels pour ChatGPT peut poser des problèmes de confidentialité. Si un employé est amené à quitter l'entreprise, il conserve l'accès à toutes les informations échangées avec ChatGPT. Il est donc recommandé d'utiliser des comptes professionnels pour accéder à ChatGPT dans le cadre professionnel. Cette approche devient encore plus pertinente si c'est l'entreprise qui gère l'utilisation de ChatGPT.

Nous avons remarqués aussi que dans le cas où il est fait usage des API, ce sont les comptes des collaborateurs à titre perso qui ont été utilisés. Il ne s’agit pas de pointer une mauvaise pratique, mais vraiment faire en sorte de prendre en charge ces sujets. Les clés générées sont ensuite utilisés dans des outils de l’entreprise et par exemple pour l’environnement Microsoft et Power Automate. En cas de départ de l’entreprise, si le collaborateur arrêter les requêtes cela devient un vrai problème.

Nous avons également remarqué que, lors de l'utilisation des API de ChatGPT, ce sont souvent les comptes personnels des collaborateurs qui sont utilisés. Il ne s’agit pas de pointer une mauvaise pratique, mais plutôt la nécessité de gérer correctement cette situation. Les clés d'API générées sont ensuite intégrées dans des outils de l'entreprise, comme dans l'environnement Microsoft et Power Automate. Encore une fois, si un collaborateur quitte l'entreprise cela a des conséquences négatives pour l’entreprise. En effet celui-ci peut désactiver les requêtes API présentes sur son compte et mettre en péril le bon fonctionnement de l’entreprise.

Il existe depuis peu une version de “ChatGPT Entreprise”. D’expérience, cette version est plus difficilement accessible, mais c’est aussi une option à étudier car elle promet une protection des données de l’entreprise.

MESURE CYBER-GPT-03 : Faire une revue des utilisateurs et des comptes et migrer quand c’est possible sur des comptes professionnels.

Besoin d’aide pour mettre en œuvre cette mesure ? N’hésitez pas à venir échanger avec nous à ce sujet. Envoyez moi un message Substack ou Linkedin

Organiser la réversibilité

De nombreuses entreprises se sont lancées dans l'utilisation de ChatGPT. J'ai récemment discuté avec des directeurs de programme qui comparent son utilisation à celle de Google Maps : il devient difficile de s'en passer. Bien que cela soit positif, il y a aussi un risque à devenir dépendant à un outil.

Nous ne sommes qu’aux prémices de l’IA, il existe encore beaucoup d’inconnus. ChatGPT restera t-il l’outil de référence dans son domaine ? Le modèle financier restera t-il le même ?

Pour moi, il est crucial d'avoir la flexibilité de changer d'outil, par exemple passer de ChatGPT à l'outil de Google, Bard, avec Gemini. D'après mon expérience, il est très difficile de procéder à un tel changement sans une planification préalable.

Il est donc important d'analyser les workflows liés à l'utilisation de ChatGPT pour s'assurer que les requêtes soient formulées de manière générique. Ainsi, en changeant simplement l'outil et l'authentification, la transition peut se faire facilement.

Dans une version entreprise, il est aussi essentiel de vérifier les clauses de réversibilité dans l'outil.

MESURE CYBER-GPT-04 : Passer en revue les workflow sur les usages de ChatGPT et s’assurer qu’ils soient génériques et puissent être adaptés à n’importe quel outil similaire.

Besoin d’aide pour mettre en œuvre cette mesure ? N’hésitez pas à venir échanger avec nous à ce sujet.

Conclusion

Comme vous l’avez compris et constaté, ChatGPT devient petit à petit un outil indispensable pour de nombreux collaborateurs. L’objectif n’est donc pas d’empêcher son utilisation mais plutôt d’accompagner les collaborateurs à l’utiliser de manière responsable. Que ce soit d’un point de vue risque, gestion des identités, sensibilisation et réversibilité.

Chez CyberLead, nous nous tenons à disposition pour échanger avec vous et mettre en place un accompagnement sur l’usage sécurisée de ChatGPT.